英语原文共 4 页,剩余内容已隐藏,支付完成后下载完整资料

BP神经网络的GA优化及其在MATLAB上的实现。

彭Hao-yue

山西财经大学管理科学与工程学院,山西太原030031。

电子邮件:yuerln@126.com

本文通过对BP神经网络结构和缺陷的分析,利用遗传算法对初始权值和阈值进行优化。它仍然使用函数模拟来比较这两个基于MATLAB的神经网络。结果表明,GA-BP神经网络可以减少函数时间,使其更科学。

关键词:反向传播;遗传算法;优化;MATLAB

1介绍

目前,基于大量历史数据的函数拟合已成为系统问题。对于非线性复杂的巨型系统,传统的拟合方法显得无效[1]。虽然人工神经网络受到专家们的青睐,他们正在对神经元对象进行抽象和模拟。

人工神经网络具有独特的信息处理能力和原始的解析能力,可以在结构上模拟人的思维过程。近年来,它已经成为处理复杂系统的一个很好的工具[1]。作为一种经典的神经网络模型,反向传播的人工神经网络(以下简称BP网络)实现了多层网络结构,体现了人工神经网络的最本质部分,在理论完善和可用性方面具有重要的意义。但由于设计和工作原理的限制,在实际应用中存在许多不足。遗传算法(遗传算法,简称GA),作为一种系统优化、适应性和高性能计算学习的建模方法,可以在全局范围内搜索最优解,或性能完美次优解,在很大程度上能够改善BP网络的不足[2]。它对BP网络的优化及其MATLAB实现的贡献,为BP的进一步应用奠定了方法基础。

2 BP算法的缺点。

BP网络也称为多层并行网络,一般包括一个输入层、许多隐藏层和一个输出层。从结构和工作原理出发,BP算法的缺点主要体现在以下两个方面[3][4]:

一方面,收敛速度慢。BP算法通过训练错误和修改网络权重来识别对象。采用梯度下降法仅以线性收敛速度进行操作。确定一个非线性方程的BP神经网络通常需要数千个训练。在识别复杂的非线性关系或模糊不确定关系时,BP神经网络需要上万次训练时间,甚至数十万次。此外,BP网络不选择学习因子或记忆因子规则。当因素过大时,会带来训练过程的脑震荡;当因素太小时,它会延长训练的过程。因此,在选择因子的过程中,可能会凸显出BP神经网络的收敛速度较差。

另一方面,它有局部极小问题。BP神经网络是一种前馈网络,其实际输出仅依赖于网络输入和权重矩阵。将数学本质考虑在内,BP神经网络是一个非线性优化问题,其目标函数本身。不可避免地存在局部最小值。这在误差表面得到了明显的反映。在错误表面,有许多局部最小值,而不只是全局最小值。

同时,在误差较小的平面区域,神经网络的映射能力明显不足,网络操作容易陷入局部极小点。利用遗传算法对BP网络进行优化。

- 利用遗传算法对BP网络进行优化。

3.1优化假设

考虑到在神经网络中,权重的初始化会严重影响最终解,而不同初始权值的设置可能会影响网络训练时间、收敛性和泛化误差。因此,我们需要通过遗传算法来修正它们,这是生物进化机制所起的作用。本文主要研究利用遗传算法优化BP神经网络的初始化网络权值和阈值[5]。

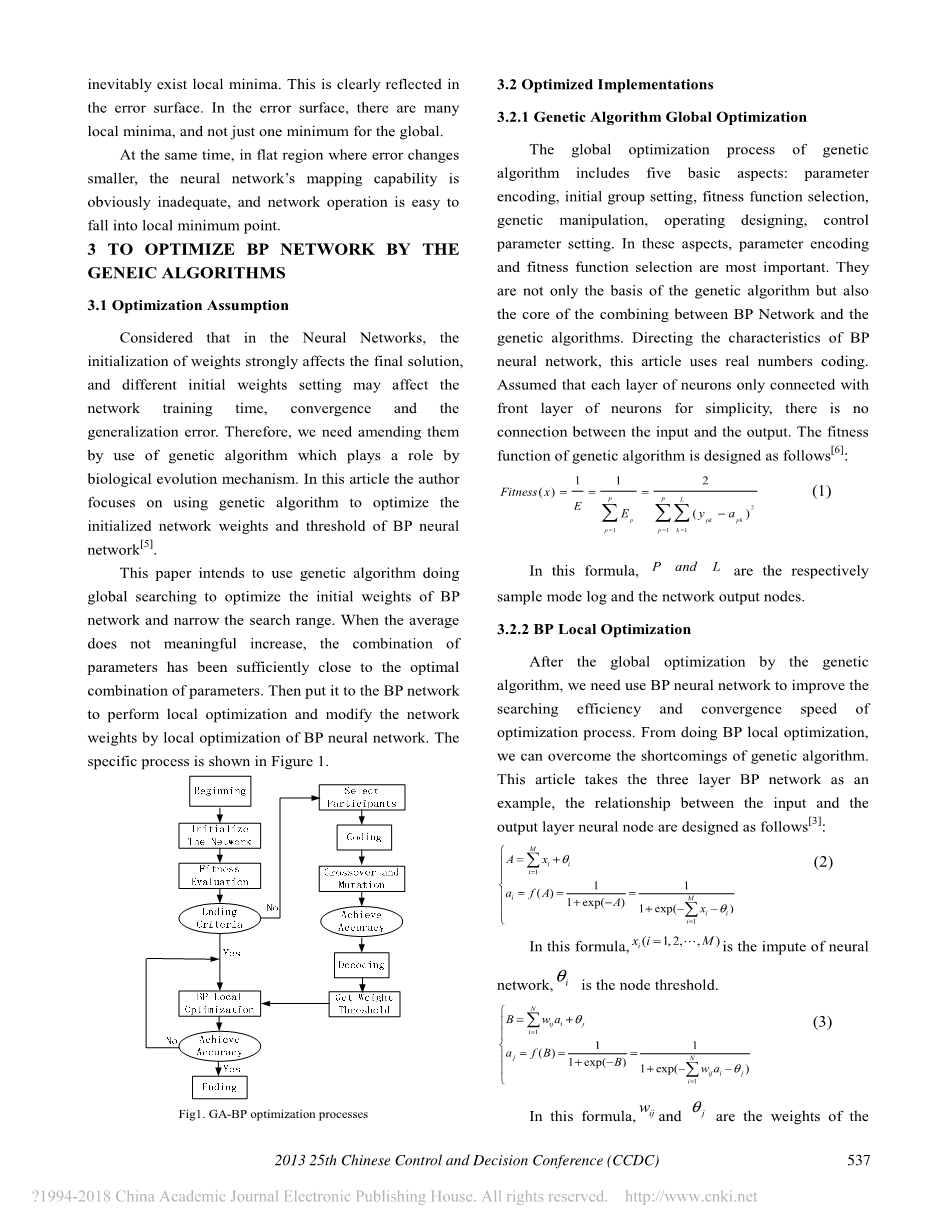

本文拟利用遗传算法进行全局搜索,优化BP网络的初始权值,缩小搜索范围。当平均值没有显著增加时,参数的组合已经足够接近参数的最优组合。然后将其应用于BP网络进行局部优化,并通过BP神经网络局部优化对网络权值进行修改。具体过程如图1所示。

图一:GA-BP优化流程

3.2优化实现

3.2.1遗传算法全局优化。

遗传算法的全局优化过程包括五个基本方面:参数编码、初始组设置、适应度函数选择、遗传操作、操作设计、控制参数设置。在这些方面,参数编码和适应度函数的选择是最重要的。它们不仅是遗传算法的基础,也是BP网络与遗传算法相结合的核心。针对BP神经网络的特点,本文采用实数编码的方法。假设每一层神经元仅仅与神经元的前层连接,以保持简单,那么输入和输出之间就没有联系。遗传算法的适应度函数设计如下[6]:

在这个公式中,P和L分别是样本模式和网络输出节点。

3.2.2 BP局部优化

在遗传算法的全局优化后,我们需要利用BP神经网络来提高搜索效率和收敛速度。优化的过程。通过对BP局部优化,可以克服遗传算法的缺点。本文以三层BP网络为例,说明了输入层和输出层的关系。

神经节点的设计如下:

在这个公式中,为输入的神经。

在这个公式中,和是权重。

在这个公式,和是权重。隐藏层和第j个节点的阈值。

4 MATLAB实现和比较

BP神经网络的一个重要功能是近似。为了验证GA-BP算法是否能够修改原始BP神经网络的不足,我们构建了一个单一的隐藏层BP网络来处理函数“”。假设输入向量为“”,输出向量为。“”。根据经验和实验表明,隐层神经元的数目为8。隐层传递函数为双曲正切函数,输出层传递函数为线性函数。分别用标准BP神经网络和GA-BP算法进行函数逼近,对应的函数拟合曲线如图2和图3所示,误差记录曲线如图4和图5所示。

4.1标准BP网络实例的实现。

4.2实例的GA-BP优化实现。

由GA优化的BP算法由GA全局搜索和BP局部优化两部分组成。GA全局搜索要求正确编码,合理定义适应度函数,正确使用主函数。具体的主要程序如下所示。

function(sol,eval)= f1(sol、options)

%定义适应度函数

initPop= initializega(10,bounds,f1);

[x,endPop bestSols、trace]= ga(bounds,f1,[],initPop)

%使用主函数。

w1 =(-0.5327,0.6854,0.9124,-0.5327,0.6854,0.1588,0.9774,0.4428);

w2 =(0.0958,0.7731,-0.0637,0.0958,0.7731,-0.9116,0.5226,-0.6020);

b1 =(0.1780,0.6622,-0.9232,0.1780,0.6622,-0.4955,-0.7191,-0.8823);

b2 = 0.2882;

%编码。

disp_fqre = 100;max_epoch = 30000;

err_goal = 0.02;lr = 0.01;

TP =[disp_fqre max_epoch err_goal,lr);

(w1,b1 w2,b2,epochs,errors,]= trainbp(w1,b1,

lsquo;tansig w2,b2,purelin,p,t,TP);

ploterr(errors);

% BP局部优化操作结果就是。

TRAINBP:18110 / 30000epochs,SSE =0.0199988。

图三:GA-BP拟合曲线

图四:BP误差曲线

图五:GA-BP误差曲线

5结论

比较两个函数逼近结果,可以得到相同误差精度下的结论(e lt;0.02)。遗传算法的操作。优化BP神经网络优于标准BP神经网络。经过遗传算法优化后,BP神经网络的迭代次数减少,误差减小。相比之下,GA-BP算法运行时间短、速度快、全局搜索能力强。通过MATLAB的优化实现,结果表明遗传算法对BP神经网络的优化是可行的、有效的。但当考虑到更复杂的情况时——多变量、多隐层、多输入和多输出——这些方法仍有待进一步研究和研究。

感谢山西大学科技项目资助(20121007),山西省教育厅教学团队建设项目,山西财经大学教学团队建设项目。

引用:

[1]Yu Fan,赵英石,李海涛,基于GA-BP神经网络算法的土壤水分检索。杂志红外和毫米波,第31卷,第3期,283-288,2012。

[2]刘嘉飞、颜刘、文峰詹、景丽、《暴雨洪水风险评估:以亚洲7个国家为例》。国际进步杂志。计算机技术,第3卷,第10期,第332 -328页,2011年。

[3]西蒙·海金,麦克马斯特,神经网络和机器学习。中国机械出版社,北京,中国,2009。

[4]王启新、杨柳、潘晓川(2008),大气污染物与呼吸系统疾病死亡率。北京。《科学的总环境》,第391卷,第143-148页,2008年。

[5]Shiwei Yu, Xiufu Guo, Kejun Zhu, Juan Du,一种神经模糊GA-BP法的地震油藏模糊规则提取方法。专家系统与应用程序,第3卷、第37期,第2037 - 2042页,2010年。

[6]韩瑞峰,遗传算法和应用实例,军械工业出版社,北京,2010。

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[22010],资料为PDF文档或Word文档,PDF文档可免费转换为Word

您可能感兴趣的文章

- 饮用水微生物群:一个全面的时空研究,以监测巴黎供水系统的水质外文翻译资料

- 步进电机控制和摩擦模型对复杂机械系统精确定位的影响外文翻译资料

- 具有温湿度控制的开式阴极PEM燃料电池性能的提升外文翻译资料

- 警报定时系统对驾驶员行为的影响:调查驾驶员信任的差异以及根据警报定时对警报的响应外文翻译资料

- 门禁系统的零知识认证解决方案外文翻译资料

- 车辆废气及室外环境中悬浮微粒中有机磷的含量—-个案研究外文翻译资料

- ZigBee协议对城市风力涡轮机的无线监控: 支持应用软件和传感器模块外文翻译资料

- ZigBee系统在医疗保健中提供位置信息和传感器数据传输的方案外文翻译资料

- 基于PLC的模糊控制器在污水处理系统中的应用外文翻译资料

- 光伏并联最大功率点跟踪系统独立应用程序外文翻译资料