基于感知质量驱动的为了水下图像增强的双子网融合

摘要:近年来,基于生成对抗网络(GAN)的水下图像增强得到了广泛的应用。针对GAN生成的水下图像纹理细节通常不够清晰的缺点,本文设计了一种融合感知子网和细化子网的生成器,以提高水下图像的视觉质量。感知子网可维护输入图像的结构和语义信息,细化子网使生成的图像在纹理细节上更加清晰。特别地,考虑到水下图像可能会影响网络的有效学习,本文提出了一种水下图像预处理单元来提高水下图像的质量。为了保持水下图像的结构和语义信息、以及纹理细节,本文分别提出了感知子网和细化子网。此外,本文还提出了颜色结构感知损失以获得良好的颜色和结构性能;提出了内容损失和细节损失以保持内容一致和纹理更清晰。最终,消融实验验证了各损伤函数的合理性和有效性。主客观实验结果表明,本文的方法能够获得视觉质量更高、纹理细节更清晰的水下图像。

关键词:水下图像增强,生成对抗网络,感知质量

引言

水下导航、深海勘探、海底测量和其他水下活动都十分依赖高质量的水下图像。因此,水下成像技术受到了广泛的关注和研究,并已应用于各种水下设备,如水下载人潜水器。由于水下环境的复杂性,水下图像常出现对比度低、颜色失真和雾状等现象。进入水中的光线会被吸收和散射,而杂质和暂停水中的物质还会加深这种现象。此外,红光波长长,容易被水吸收;而蓝光和绿光波长较短,不容易被水吸收,因此,水下图像通常是蓝绿色色调。为了克服这些畸变,可以增强水下图像以提高视觉质量。

目前水下图像增强(underwater image enhancement, UIE)方法有三种,分别是:基于物理模型的方法[4-7]、基于非物理模型的方法[8-11]和基于深度学习的方法[12-18]。

本文提出了一种新的水下图像增强方法,利用氮化镓来提高退化水下图像的质量。该方法由感知子网和细化子网两部分组成,能够生成高质量、清晰的水下图像。本文的主要贡献可以总结如下:

1)退化的水下图像中包含的噪声信息可能会导致网络无法学习到有效的信息,考虑到此,本文提出了一种水下图像预处理单元来增强退化的水下图像,再将优化后的水下图像作为网络的联合输入,这种多输入设计可以使网络学习到更准确的信息。

2)退化的水下图像往往会出现颜色偏差、对比度低、细节模糊等视觉畸变现象,单一的网络生成器可能无法有效地学习图像的特征信息。为此,本文提出了一种融合感知子网和细化子网的生成器。两个子网分别对图像进行颜色校正和细节增强,使生成器生成清晰的水下图像。

3)考虑到水下图像增强的关键是在校正颜色的同时保持内容结构的一致性。因此,本文设计了多种由感知质量驱动的损失函数,包括颜色结构感知损失、细节损失和内容损失。多重损失函数的设计可以更好地衡量所提网络模型的质量。

本文的其余部分组织如下:本文所提议的方法在第二节中详细描述,实验结果将在第三节介绍,并在第四节得出结论。

方法

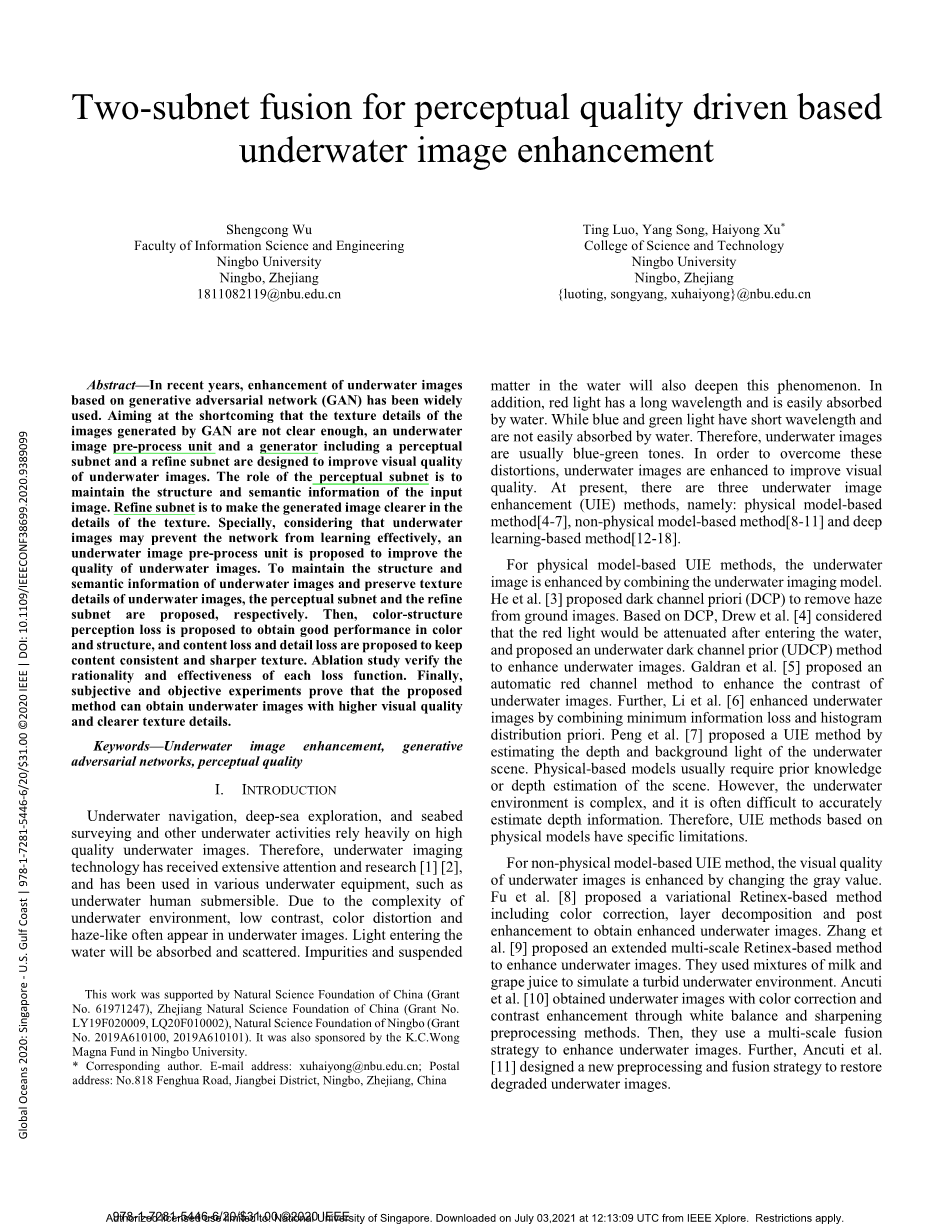

水下图像退化可能会导致GAN无法学习重要信息,所以本文设计了一种水下图像预处理单元和具有两个子网的发生器,如图1所示。

由于水下环境的复杂性,所捕获的水下图像通常会出现严重的畸变。因此,使用原始水下图像作为网络的输入可能会使网络无法捕捉到重要特征。为避免此,水下图像预处理单元可以对水下图像进行白平衡和锐化处理,然后再将处理后的图像作为网络的输入。这种预处理操作在一定程度上提高了水下图像质量,使网络能够学习到更丰富的信息。

为了生成更清晰的水下图像,本文提出了一种由感知子网和细化子网组成的生成器。感知子网保持图像的语义结构信息,细化子网使生成的图像纹理细节更加清晰。本文还定义了颜色结构感知损失,缓解水下图像会出现的严重颜色偏差。此外,为了使生成的图像内容一致,边缘细节更清晰,本文采用了内容损失和细节损失。

图像预处理

由于原始退化的水下图像含有过多的噪声信息,可能会导致GAN不能有效地学习。因此,将退化的水下图像x进行白平衡处理[10]得到颜色改进后的图像xwb,再将改进后的图像锐化[11],得到图像xsp,如图2所示。白平衡图像xwb有效地改善了原始水下图像x的色彩问题,锐化后的图像xsp边缘纹理更加清晰。然后,将退化的水下图像和白平衡图像连接到生成器的感知子网,将锐化图像输入到细化子网,这种多输入设计允许网络学习更多重要的信息。

网络结构

为了使网络能够成功地进行颜色校正,并使图像具有更清晰的纹理细节,本文提出的生成器体系结构由感知子网和细化子网组成。感知子网保持了图像的内容结构特征,而细化子网主要使生成的图像纹理更清晰。首先,对图像进行下采样,减少计算量,增加感受野。网络中包含九个残差块,用于残差学习。然后,对图像进行上采样,恢复到原始大小。除最后一层外,其他层均采用批量归一化,使模型训练更加稳定,并且激活函数采用ReLU (Rectified Linear Unit)。Tanh用于将输出值缩放到[-1 1]。细化子网由三个简单的Conv LReLU组成,用于提取图像的边缘细节特征。最后,两个子网的输出通过像素级相加得到清晰的水下图像。

损失函数

对抗性损失

目前GAN在图像风格转换和超分辨率重建方面取得了很大的成功,但生成图像的质量和训练的不稳定性仍然是需要解决的问题。使用最小二乘损失使训练更加稳定,可以产生更高质量的图像,因此对抗性损失可以表示为:

其中z表示生成的图像,N像素数。

颜色结构感知损失

将原始图像x与白平衡图像xwb联合输入感知子网,计算出输出图像和输入图像的颜色结构感知损失。

色差:为了测量白平衡图像xwb与生成图像z之间的色差,使用高斯核模糊两者的纹理细节,然后计算它们之间的颜色损失:

式中B(xwb)和B(z)表示高斯模糊算子运算后xwb和z的图像,可以表示为:

二维高斯模糊算子可以表示为:

结构相似度损失:结构相似度是两幅图像相似度的度量。考虑到生成的图像与原始图像在结构上是一致的,可将结构相似度损失定义如下:

其中p表示图像的像素。

细节损失

为了使生成的图像在纹理细节上更加清晰,在生成器中有两个子网。通过细化子网,生成的图像纹理细节更加清晰。精细子网提取锐化图像的边缘特征,并将边缘特征添加到感知子网的输出中,使其既具有良好的颜色校正能力,又具有清晰的纹理细节。细节损失可以表示为:

内容损失

如L1损失的像素级损失,无法捕捉两幅图像之间的感知差异。因此,使用经过预处理的VGG-19提取生成图像的高级特征,再与ground truth进行差异处理。内容损失可以定义为:

总损失

总损失可以表示为:

生成器的目标是生成足以欺骗鉴别器的图像,而鉴别器的目标是区分图像的真伪。

训练细节

本项目使用Tensorflow深度学习框架来实现代码。利用ADAM优化器对网络参数进行优化。实验中,学习速率为0.0002,批量大小为1,迭代次数为20。用于训练的图像分辨率为256times;256times;3,像素值被压缩到[-1 1]的范围。配置英特尔(R) Xeon (R) CPU E5-2620 v4、32G RAM、GTX 1080Ti GPU的计算机,优化网络参数耗时约6小时。

实验结果

主观评价

在本小节中,将8种经典的水下图像增强方法RB [8] 、UDCP [4] 、UIBLA [7] 、RED [5] 、CycleGAN [12]、WSCT[13]、UGAN[14]和FGAN[15]与本文方法进行比较。CycleGAN、WSCT、UGAN和FGAN是基于深度学习的方法,其他的方法是非基于深度学习的方法。不同方法对U45数据集的增强结果如图3所示。

RB可以有效地校正偏绿和偏蓝的场景,但对雾状场景的去雾效果不够好;UDCP、UIBLA和RED不能有效地校正不同类型的水下图像;UDCP加深了带蓝色的场景图像;而UIBLA错误地改变了水下图像的颜色;CycleGAN对于蓝色场景的色彩校正效果较差,但是对于雾状场景的去雾效果很好;WSCT是基于CycleGAN的,它对水下图像的增强效果比CycleGAN差;UGAN、FGAN和该方法能够成功地对不同场景下的水下图像进行校正;UGAN、FGAN和所提方法的性能与人眼的视觉效果难以区分,但与UGAN和FGAN相比,该方法能更好地保持纹理细节。

客观评价

受观察条件和观察者经验的限制,主观评价不能证明图像的质量。因此,采用水下彩色图像质量评价[19](UCIQE)和水下图像质量测量[20](UIQM)来评价水下图像的质量。UCIQE和UIQM都是水下图像的质量评价指标。表一给出了不同方法对U45数据集的质量评价得分。UCIQE和UIQM越高越好。水下图像质量。第一个和第二个分数分别用红色和蓝色标记。从表一可以看出,UGAN在UCIQE中表现得很好,而所提出的方法在UIQM中表现突出。

消融研究

在本小节中,设计消融研究来验证每个损失函数的合理性。颜色损失(color loss)、结构相似度损失(-SSIM loss)、细节损失(-detail loss)和内容损失(-content loss)被分别去除做消融研究。实验的客观质量评价得分见表二。第一个和第二个分数分别用红色和蓝色标记。从表二可以看出,去除单个损失函数后,UCIQE和UIQM的得分有所下降,这证明了每个损失函数都能有效地提高水下图像的质量。

应用测试

为了进一步证明所提方法能够有效提高水下图像的质量,分别使用SIFT特征匹配[21]和YOLO-V3[22]对原始水下图像和增强后的图像进行了测试。图4为SIFT特征匹配结果。由于该方法能够正确地校正颜色,有效地保留纹理细节,增强后的图像能够检测出更多的关键点,匹配结果也更加准确。YOLO-V3的试验结果如图5所示。从图5中可以发现,YOLO-V3在退化的水下图像中无法识别人,甚至将海龟误认为鸟类。相反,YOLO-V3可以成功地在本文方法增强的水下图像中识别人。

结论

本文提出了一种融合感知子网和精细子网的生成对抗网络(generative adversarial network, GAN),用于对退化水下图像进行颜色校正。针对水下图像存在的颜色失真和对比度低的问题,对退化的水下图像进行了白平衡和锐化处理。然后,将优化后的图像和降级后的图像作为网络的输入。多输入设计可以使网络学习到更重要的特征信息。感知子网保留了图像的结构特征和语义信息,细化子网使生成的图像在边缘纹理上更加清晰。通过设计多种损失功能:颜色结构感知损失、细节损失和内容损失,生成的水下图像具有更高的视觉质量和更清晰的纹理细节。通过对低层和高层视觉任务的仿真验证了该方法的有效性和鲁棒性。

参考文献 剩余内容已隐藏,支付完成后下载完整资料

英语原文共 6 页,剩余内容已隐藏,支付完成后下载完整资料

资料编号:[596206],资料为PDF文档或Word文档,PDF文档可免费转换为Word

您可能感兴趣的文章

- 饮用水微生物群:一个全面的时空研究,以监测巴黎供水系统的水质外文翻译资料

- 步进电机控制和摩擦模型对复杂机械系统精确定位的影响外文翻译资料

- 具有温湿度控制的开式阴极PEM燃料电池性能的提升外文翻译资料

- 警报定时系统对驾驶员行为的影响:调查驾驶员信任的差异以及根据警报定时对警报的响应外文翻译资料

- 门禁系统的零知识认证解决方案外文翻译资料

- 车辆废气及室外环境中悬浮微粒中有机磷的含量—-个案研究外文翻译资料

- ZigBee协议对城市风力涡轮机的无线监控: 支持应用软件和传感器模块外文翻译资料

- ZigBee系统在医疗保健中提供位置信息和传感器数据传输的方案外文翻译资料

- 基于PLC的模糊控制器在污水处理系统中的应用外文翻译资料

- 光伏并联最大功率点跟踪系统独立应用程序外文翻译资料